當我們分不清真假,風險就已走進職場與生活

你是否曾在社群平台看到一段影片,直覺覺得「好像哪裡怪怪的」,卻又說不上來。或者收到一封看似正式的通知信件,署名專業單位,內容合情合理,卻在事後才發現是詐騙。

這些經驗,已成為多數職場工作者的日常。隨著AI人工智慧被廣泛應用,虛假訊息與詐騙不再只是技術問題,而是直接影響人們判斷、信任與行動的心理議題。當真假界線變得模糊,人們更容易被操弄,也更容易感到不安與無力。

從員工協助方案與組織風險管理的實務來看,這不只關乎資安或法遵,更牽涉到心理安全感、決策品質與組織穩定。

當科技讓「看起來是真的」變得更有說服力

假訊息並非今天才出現。早在電視、平面媒體興盛的年代,人們就已開始習慣被包裝過的影像與敘事吸引注意力。

然而,人工智慧的加入,讓虛構內容可以被大量產出,而且成本極低、速度極快。文字可以自動生成,圖片可以即時合成,影片與聲音也能被高度擬真地模仿。

人們在資訊判斷上並非完全理性。我們更容易相信:

- 符合既有立場的內容

- 情緒強烈的敘事

- 看起來專業或具權威感的說法

AI 正是利用了這些人性特質,放大錯誤信念的傳播效果。

為什麼人會被 AI 假訊息影響

AI 假訊息之所以有效,通常不是因為人們不聰明,而是因為三個常見心理狀態:

1. 不確定感高的時候,更想要一個答案

當環境動盪、組織調整、政策變動頻繁時,人們會本能地尋找可以「解釋一切」的說法。AI 生成內容往往給出清楚、果斷、情緒鮮明的敘事,正好填補這個空缺。

2. 重複出現的訊息會被誤認為真實

心理學稱為真相錯覺效應 (Illusory Truth Effect) 這是指人們僅僅因為資訊被重複提及,就傾向於認為它是真實的現象。即使內容本身錯誤,只要在不同平台、不同形式中反覆出現,人腦就容易降低警覺。

3. 影像與聲音比文字更容易取得信任

人們對文字仍會存疑,但看到影片或聽到聲音時,判斷門檻會明顯下降。這也是 AI 深偽影片與仿真語音特別具風險的原因。

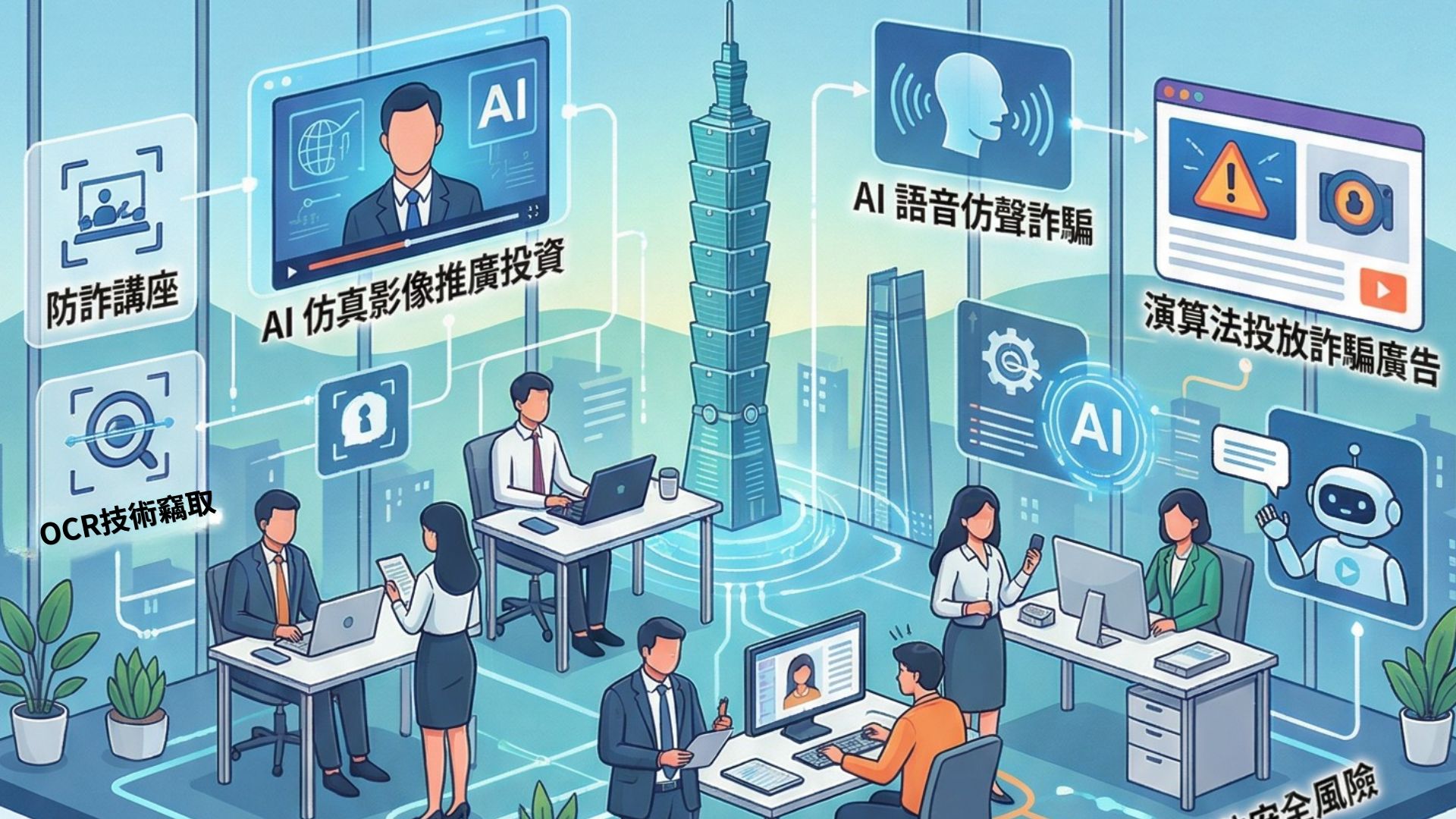

AI 假訊息不只存在網路,也進入工作場域

許多人以為假訊息只影響政治或社群輿論,但在企業現場,影響早已浮現。

實務中常見的情境包括:

- 偽造高階主管語音要求緊急匯款

- 仿冒內部公告造成員工恐慌

- 利用 AI 生成的專業文件進行詐騙

- 偽裝成外部顧問或合作單位索取資料

對 HR 與職安人員而言,這些事件不只涉及資安與流程,也會衝擊員工的信任感與心理安全。

當真假難辨,最先受傷的是「判斷能力」

政治哲學家漢娜鄂蘭曾提醒,如果人們長期處在無法分辨真假的狀態,後果不只是相信錯誤資訊,而是逐漸失去判斷與行動的能力。

在組織中,這樣的狀態可能表現為:

- 員工對任何公告都抱持懷疑

- 傳言比正式溝通更有影響力

- 情緒反應凌駕事實討論

- 對制度與領導的信任下降

這正是 AI 假訊息對職場最隱晦卻長遠的影響。

企業與 HR 可以從哪裡開始因應

因應 AI 假訊息與詐騙,不只是技術防堵,更是心理與制度設計。

1. 把資訊判斷納入員工教育

不需要每位員工都懂 AI 技術,但可以協助大家建立基本判斷原則

- 重要資訊是否有第二來源

- 是否刻意製造恐慌或急迫感

- 是否要求跳過正常流程

2. 建立清楚的正式溝通管道

當組織內部資訊透明且一致,假訊息較難找到空間滋生。

3. 將心理安全納入風險管理

員工若害怕提問或質疑,就更容易在不安中相信錯誤資訊。鼓勵查證與討論,本身就是一種防詐策略。

4. 善用 EAP 作為支持資源

當員工因詐騙、誤信資訊或資訊焦慮感到壓力時,專業(法律、財務、心理)支持能協助他們重新整理判斷與情緒,而不是陷入自責或恐慌。

這不只是資安議題,也是一個關於信任、心理安全與組織韌性的課題。

人工智慧本身並非威脅,真正的風險在於,當真假難辨時,人們是否仍保有思考與判斷的能力。在職場中,信任是合作的基礎。當科技讓信任變得脆弱,組織更需要清楚的制度、穩定的支持與開放的對話。

面對 AI 假訊息與詐騙,企業能做的,不只是防堵錯誤資訊,更是協助員工在不確定中,重新建立判斷與安心感。這正是員工協助方案在當代職場中,愈來愈重要的原因之一。

延伸閱讀:

References: